CSAGAN:LinesToFacePhoto: Face Photo Generation from Lines wi

在本文中,我们探讨了从线条生成逼真的人脸图像的任务。先前的基于条件生成对抗网络(cGANs)的方法已经证明,当条件图像和输出图像共享对齐良好的结构时,它们能够生成视觉上可信的图像。然而,这些模型无法合成具有完整定义结构的人脸图像,例如眼睛、鼻子、嘴巴等,特别是当条件线图缺少一个或多个部分时。为了解决这一问题,我们提出了一个条件自注意生成对抗网络(CSAGAN)。我们在cGANs中引入了条件自注意机制来捕获面部不同区域之间的长范围依赖关系。我们还建立了一个多尺度判别器。大规模判别器增强了全局结构的完整性,小规模判别器增强了细节,增强了生成的人脸图像的真实感。我们在CelebA-HD数据集上通过两个感知用户研究和三个定量指标来评估所提出的模型。实验结果表明,该方法在保留人脸结构的同时,生成了高质量的人脸图像。我们的结果在定量和定性上都超过了最先进的方法。

1 INTRODUCTION

当从头开始创作某个东西时,一个自然和直接的方法就是画线。线条绘制是一种有效的视觉思维方式。它比文本更具体地描述所需对象的结构和形状。将线条转化为逼真的图像在计算机图形学和计算机视觉领域引起了广泛的关注。得益于互联网上海量的图像,在过去的十年中,许多基于线的图像检索和图像合成技术的方法被提出[3,9,29,36]。虽然这些方法成功地保持了目标物体或场景的基本结构,但由于传统图像合成技术的能力有限,它们通常无法生成精细的细节。

随着深度神经网络(deep neural networks, DNN)的出现,提出了一系列基于生成对抗网络(generate adversarial networks, GANs)的逼真图像合成方法[18,30]。GANs中的一个生成器和一个判别器通过玩一个最小最大的游戏来训练,以使生成的样本与真实样本难以区分。图像到图像的转换是条件GANs的一种具体应用,其目的是将一个域内的图像转换为另一个域内的目标图像,同时保留两幅图像的主要内容和结构。自从第一个图像到图像的转换模型pix2pix[13]被提出以来,监督和非监督的方式都有很多变体[16,20,33,37,39,40]。当完整和详细的结构在条件图像中给出时,这些模型成功地合成了真实纹理。

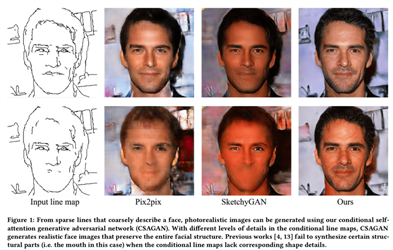

然而,当条件图像只提供了部分结构,这正是线条图或边缘图会遇到的情况,以前的模型无法完成缺失的结构。这主要是因为这些方法在合成生成的图像时严格遵循所提供的边缘;因此,它们不会在只提供了少量边的地方生成新的结构。由于人脸是由定义良好的结构部分组成的,例如鼻子、嘴巴、眼睛等,因此合成的人脸图像应该包含所有这些结构部分,以使其看起来更真实,即使条件线图在这些部分的假定位置周围缺少边缘。如图1所示:

使用我们的方法,从两个具有不同层次细节的线图生成的图像更加真实,因为它们具有完整的全局结构和精细的纹理。之前的方法[4,13]在嘴巴区域边缘不完整的情况下,无法渲染出真实的人脸图像。

造成这一失败的根本原因主要有两方面:

首先,现有的GANs主要建立在卷积层上。由于卷积运算符根据其内核大小有一个局部接受域,因此通过叠加多个卷积层可以获得一个较大的接受域。然而,当前的网络优化器要通过几个卷积层[38]来发现合适的参数值来对长范围的依赖关系进行建模并非易事。

其次,GANs中现有的判别器侧重于检测局部patch,而不是捕获全局信息;因此,它们不能强制生成器合成生成的图像的全局结构。

针对第一个问题,我们提出了一个有条件的自注意机制来解决这个问题。自注意机制是将一个位置的响应计算为所有位置特征的加权和,能够捕获不同部分的长范围依赖性[6,31,34,38]。为了适应图像到图像转换的条件设置和鼓励GAN模型充分利用直接来自条件图像的信息,我们提出一个条件自注意模块(CSAM),使更高层去感受来自条件图像的信息并捕获长范围的依赖。对于第二个问题,我们建立了一个多尺度判别器来从不同的层次捕获信息。小尺度判别器具有局部接受域,改善了局部patch的精细纹理,而大尺度判别器保证了生成图像的全局结构的完整性。

在这篇论文中,我们着重于从线条图生成人像照片的任务,同时保留明确的面部结构,,这对面部照片的真实性至关重要。我们的贡献总结如下:

本文首先将自注意机制引入到线条到图象的转换中,提出了一种新的条件自注意生成对抗网络。与基于卷积的方法不同,该模型能够在人脸图像上进行长范围依赖和全局结构的建模。

温馨提示: 本文由Jm博客推荐,转载请保留链接: https://www.jmwww.net/file/web/42438.html

- 上一篇:JS正则验证数字格式2

- 下一篇:asp.net 引用WebService

![[转]Node.js中package.json中^和~的区别 [转]Node.js中package.json中^和~的区别](/uploads/allimg/200519/054J34453_lit.png)