Flume数据传输的基本单元

标签:

flume 1.1 Flume界说Flume是Cloudera供给的一个高可用的,高可靠的,漫衍式的海量日志收罗、聚合和传输的系统。Flume基于流式架构,灵活简单。

大数据框架大抵分为3类:

数据的收罗和传输:flume

数据的存储:HDFS

数据的计算:MapReduce

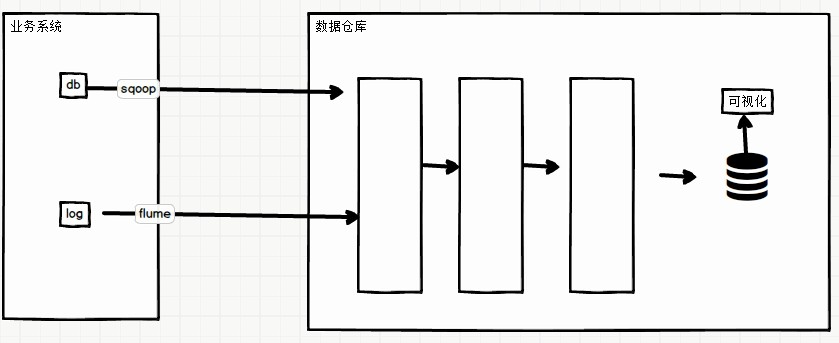

flume主要应用于数仓

数仓中,HDFS用来存储数据,HIVE用来对数据进行打点和计算(分层计算)。分析出成公然后给关系型数据库然后再做可视化等。

flume在项目中的根基架构:

Flume最主要的感化就是:实时读取处事器本地磁盘的数据,将数据写入到HDFS。因此Flume就要部署到日志地址的那台节点上,或者说日志得发送到Flume地址的节点。本日志和Flume必需在一起才行。

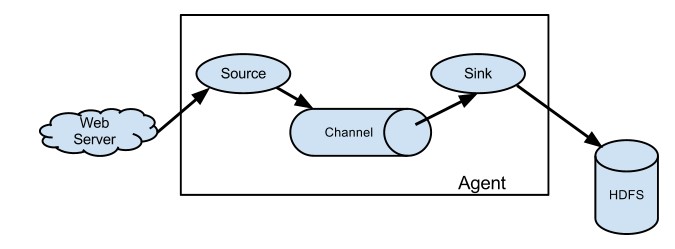

1.4 flume根本架构flume根本架构如图所示:

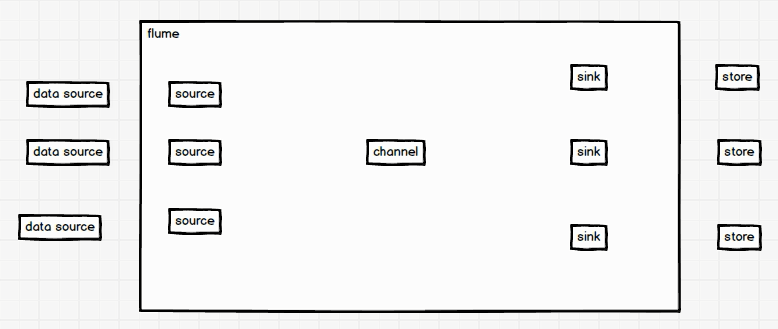

如何选择相应的flume呢?

按照data source 和 store 来选择相应的source和sink

Agent是一个JVM进程,它以事件的形式将数据从源头送至目的。

Agent主要有3个部分构成,Source、Channel、Sink。

Source是卖力接收数据到Flume Agent的组件。Source组件可以措置惩罚惩罚各类类型、各类格局的日志数据,包孕avro、thrift、exec、jms、spooling directory、netcat、sequence generator、syslog、http、legacy。

此中:

avro:(序列化框架)flume在搭建的时候可能会搭建多层,即涉及到flume的串联,avro主要用在两个flume之间,前一个flume的avro sink,后一个flume的avro source

exec: 主要用来监控一个文件,后面可以跟shell命令——tail -f 文件名 这样就可以监控这个文件了。出产环境中一般不用exec source。

spooling directory: 监控一个路径下的多个文件,

netcat: 用来监听网络端口,如果外界向机器的1234端口发送数据,通过netcat就可以监听到1234这个端口传进来的数据。

Sink不停地轮询Channel中的事件且批量地移除它们,并将这些事件批量写入到存储或索引系统、或者被发送到另一个Flume Agent。

Sink组件目的地包孕hdfs、logger、avro、thrift、ipc、file、HBase、solr、自界说。

hdfs: 最根基最常用的就是hdfs sink, 将数据存储到hdfs上。

logger: 一般用来做测试,将数据以日志的形式打印在控制台。

avro: 同avro source 进行对接,同样是涉及到flume的串联的时候使用。

file: 输出到本地文件。

hbase: 输出到HBase数据库。

Channel 两个主要的感化:解耦和缓冲。

Channel是位于Source和Sink之间的缓冲区。因此,Channel允许Source和Sink运作在差此外速率上。Channel是线程安适的,可以同时措置惩罚惩罚几个Source的写入操纵和几个Sink的读取操纵。

Flume自带两种Channel:Memory Channel和File Channel。

Memory Channel是内存中的行列队伍。Memory Channel在不需要关心数据丢掉的情景下适用。如果需要关心数据丢掉,那么Memory Channel就不应该使用,因为措施死亡、机器宕机或者重启城市导致数据丢掉。

长处:速度块,延迟低,,吞吐量高

错误谬误:可能会丢数据

File Channel将所有事件写到磁盘。因此在措施封锁或机器宕机的情况下不会丢掉数据。

长处:不会丢数据

错误谬误:速度没有memory channel快,延迟没有memory channel低,吞吐量低

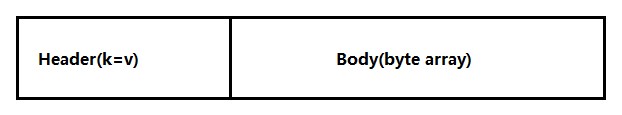

传输单元,Flume数据传输的根基单元,以Event的形式将数据从源头送至目的地。

Event由Header和Body两部分构成,Header用来存放该event的一些属性,为K-V布局,Body用来存放该条数据,形式为字节数组。

1 flume根本入门

标签:

原文地点:https://www.cnblogs.com/zhqin/p/12230301.html

温馨提示: 本文由Jm博客推荐,转载请保留链接: https://www.jmwww.net/file/web/31059.html

![[转]Node.js中package.json中^和~的区别 [转]Node.js中package.json中^和~的区别](/uploads/allimg/200519/054J34453_lit.png)