1.urlopen函数: 在Python3的urllib库中

urllib库是Python中一个最根基的网络请求库。可以模拟浏览器的行为,向指定的处事器发送一个请求,并可以生存处事器返回的数据。

1.urlopen函数:

在Python3的urllib库中,所有和网络请求相关的要领,,都被集到urllib.request模块下面了,以先来看下urlopen函数根基的使用:

from urllib import request resp = request.urlopen(‘‘) print(resp.read())实际上,使用浏览器访谒百度,右键检察源代码。你会发明,跟我们适才打印出来的数据是一模一样的。也就是说,上面的三行代码就已经帮我们把百度的首页的全部代码爬下来了。一个根基的url请求对应的python代码真的非常简单。

以下对urlopen函数的进行详细讲解:

url:请求的url。

data:请求的data,如果设置了这个值,那么将酿成post请求。

返回值:返回值是一个http.client.HTTPResponse东西,这个东西是一个类文件句柄东西。有read(size)、readline、readlines以及getcode等要领。

2.urlretrieve函数:

这个函数可以便利的将网页上的一个文件生存到本地。以下代码可以非常便利的将百度的首页下载到本地:

from urllib import request

request.urlretrieve(‘‘,‘baidu.html‘)

3.编码解码urlencode函数/parse_qs函数:

urlencode函数

用浏览器发送请求的时候,如果url中包罗了中文或者其他特殊字符,那么浏览器会自动的给我们进行编码。而如果使用代码发送请求,那么就必需手动的进行编码,这时候就应该使用urlencode函数来实现。urlencode可以把字典数据转换为URL编码的数据。示例代码如下:

from urllib import parse data = {‘name‘:‘爬虫根本‘,‘greet‘:‘hello world‘,‘age‘:100} qs = parse.urlencode(data) print(qs)parse_qs函数:

可以将颠末编码后的url参数进行解码。示例代码如下:

from urllib import parse qs = "name=%E7%88%AC%E8%99%AB%E5%9F%BA%E7%A1%80&greet=hello+world&age=100" print(parse.parse_qs(qs))

4.urlpares函数/urlsplit函数:

有时候拿到一个url,想要对这个url中的各个构成部分进行支解,那么这时候就可以使用urlparse或者是urlsplit来进行支解。示例代码如下:

from urllib import request,parse url = ‘?username=zhiliao‘ result = parse.urlsplit(url) # result = parse.urlparse(url) print(‘scheme:‘,result.scheme) print(‘netloc:‘,result.netloc) print(‘path:‘,result.path) print(‘query:‘,result.query)urlparse和urlsplit根基上是一模一样的。独一不一样的处所是,urlparse里面多了一个params属性,而urlsplit没有这个params属性。好比有一个url为:url = ‘;hello?wd=python&username=abc#1‘,

那么urlparse可以获取到hello,而urlsplit不成以获取到。url中的params也用得对照少。

5.request.Request函数:

如果想要在请求的时候增加一些请求头,那么就必需使用request.Request类来实现。好比要增加一个User-Agent,示例代码如下:

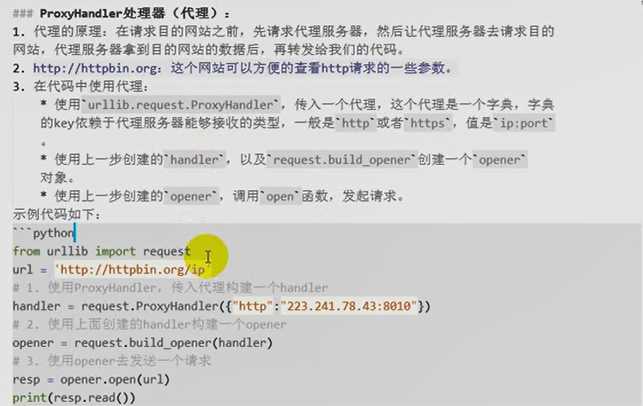

from urllib import request headers = { ‘User-Agent‘: ‘Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/62.0.3202.94 Safari/537.36‘ } req = request.Request("http://www.baidu.com/",headers=headers) resp = request.urlopen(req) print(resp.read())6.代办代理器设置(ProxyHandler):

很多网站会检测某一段时间某个IP的访谒次数(通过流量统计,系统日志等),如果访谒次数多的不像正凡人,它会禁止这个IP的访谒。

所以我们可以设置一些代办代理处事器,每隔一段时间换一个代办代理,就算IP被禁止,依然可以换个IP继续爬取。

urllib中通过ProxyHandler来设置使用代办代理处事器,下面代码说明如何使用自界说opener来使用代办代理:

代码:

温馨提示: 本文由Jm博客推荐,转载请保留链接: https://www.jmwww.net/file/web/30998.html

![[转]Node.js中package.json中^和~的区别 [转]Node.js中package.json中^和~的区别](/uploads/allimg/200519/054J34453_lit.png)